4月20日,谣传即将发布的DeepSeek V4让AI爱好者们的愿望再次落空。

在过去的一年里,国内AI模型群雄逐鹿,几乎每天都有刷新人们认知的新消息。

而中文互联网对大模型的讨论也已经经过了三轮竞争周期:

第一轮是堆砌参数量的比拼,第二轮是上下文长度的竞争,第三轮则是喜闻乐见的价格战。

但Kimi K2.6的诞生,意味着月之暗面也率先进入了大模型竞争的下半场深水区,也就是长程执行(Long-range Reasoning & Execution)。

尽管在这个值得欢喜的日子泼冷水有些不解风情,但我们仍然必须直面一个客观存在的分水岭。

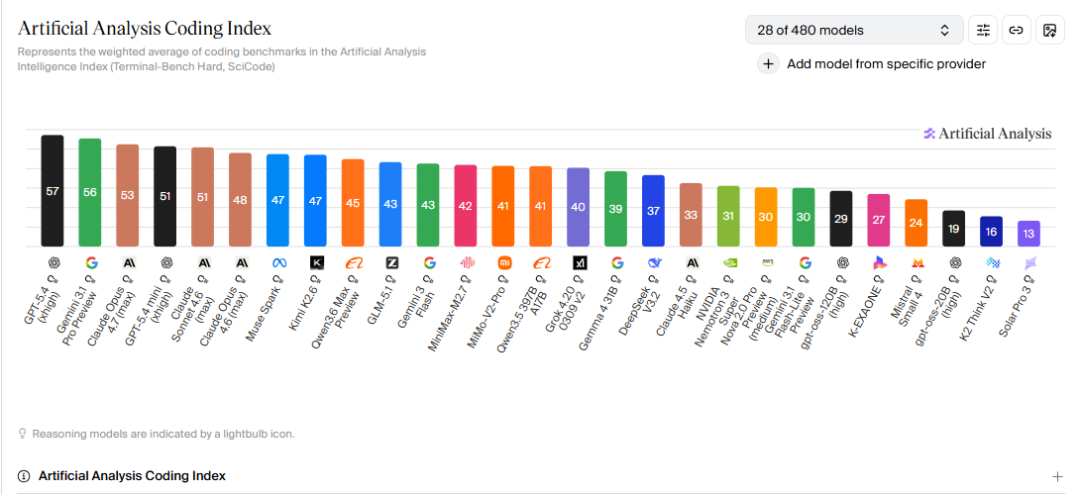

在不考虑多模态的前提下,国内外AI模型的水平已经出现了明确的代差。

刚刚发布Claude Opus 4.7的Anthropic和更新的Codex的OpenAI在编程等强逻辑领域已经遥遥领先,这些产品也成为拥有访问渠道且预算充足的开发者的首选。

国产AI企业推出的新产品,本质上还是追赶两家企业上一代的旗舰模型,并以此竞争成为其余开发者们的“国产平替”。

这种平替的战略并非被动防守,而是在性能分水岭明确的现状下,通过极致的执行力和本土化适配试图在中国AI领域内生根发芽。

如果说Kimi的上半场凭借长文本和超大参数量赢得了用户心智,那么K2.6的出现则宣告了战略重心的转移:从一个信息容器,到一台执行引擎。

读完十万字的文档、做好几十页的PPT、下单网购各种产品,那是上个时代(尽管只过去了两个月)的Agent做的事。

而Kimi K2.6,是一个可以连续工作13小时、指挥300个下属“数字牛马”、独立交付数千行工业级代码的“数字承包商”。

这场深夜发布的背后,也隐藏着CEO杨植麟对规模化法则(Scaling Law)的最新修正和月之暗面试图通过KVV项目重塑开源生态链的深远规划。

01

长程执行的奇点

尽管详细的技术论文还没有发布,但官方博客中的两个数据已经足以让技术圈和商业界同时感到震惊:

13个小时连续编码、300个子Agent并行协作。

在过去的几个月中,Agent这个词被人口口相传,仿佛AGI在几天之后就会突然实现。

但现实是,绝大部分Agent直至目前还只是玩具,或者不太好用的工具。

一旦任务链路被拉长,AI必然陷入记忆衰减或逻辑漂移。对于一个业务场景复杂的企业来说,这个核心痛点直接制约了Agent的实际落地。

然而,Kimi K2.6实现了从任务到工程的质变。

就像这夸张的数据给人们带来的直观感受一样,Kimi K2.6展现出了一种令人难以想象的长程稳定性。

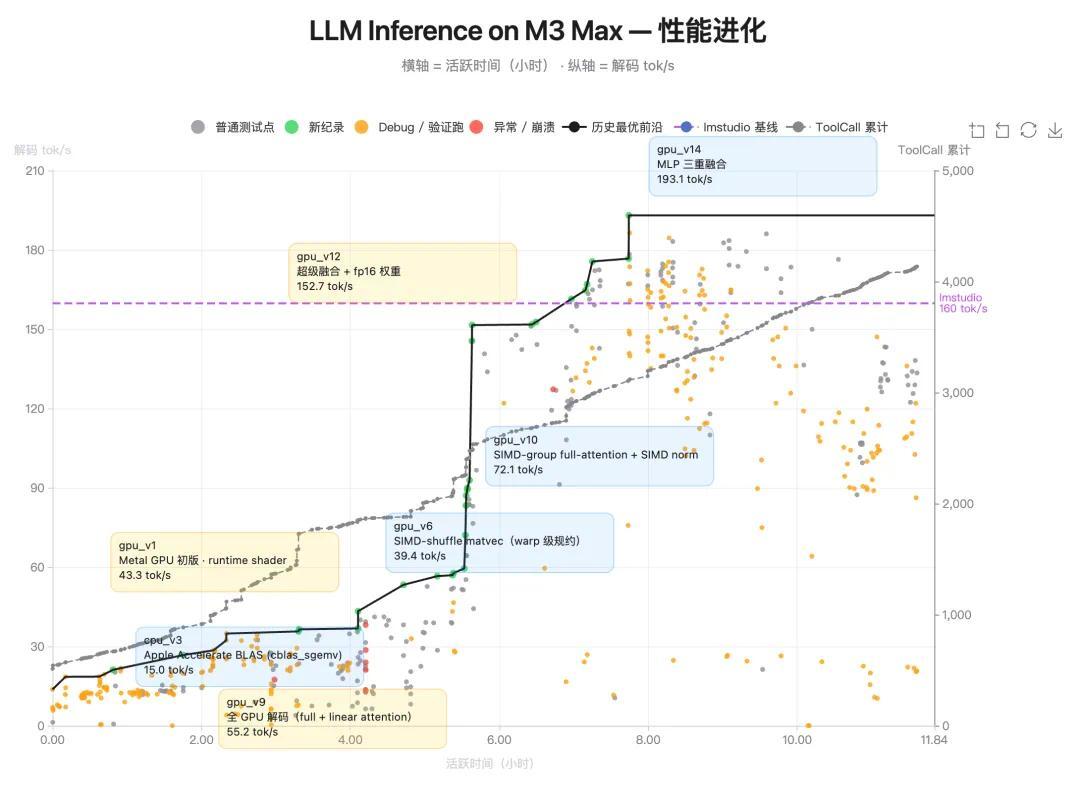

在官方实测的一个极端场景中,K2.6成功在Mac本地下载了Qwen 3.5的一款轻量级模型,甚至还通过很冷门的Zig编程语言实现并优化了推理过程。

在超过4000次工具调用和12小时的不间断运行后,K2.6的吞吐量从15 tokens/s直接提升到了恐怖的193 tokens/s。

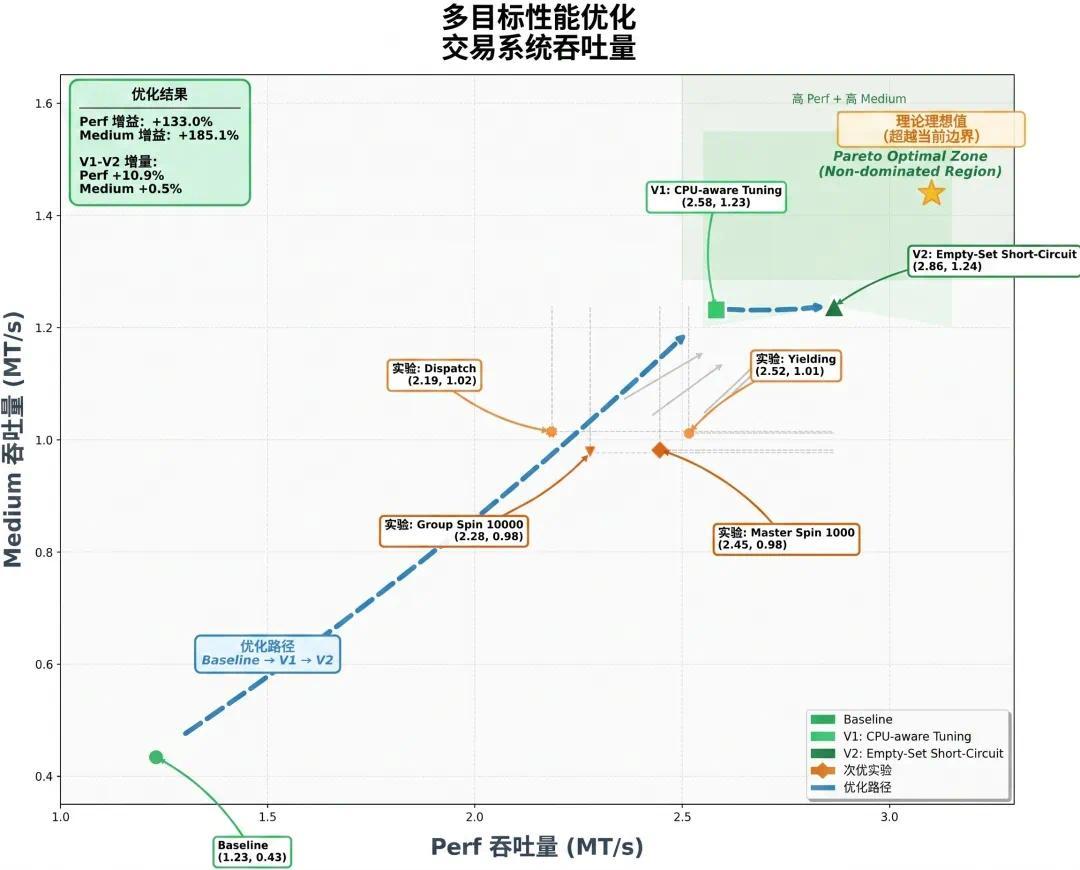

而在另一个案例中,K2.6摇身一变成为了专家级别的系统架构师。

在重构拥有8年历史的开源金融撮合引擎exchange-core时,它通过分析CPU火焰图确定了瓶颈,并精准地修改了超过4000行代码,使得峰值吞吐量飙升了133%。

在这两个典型的应用背后隐藏的商业真相呼之欲出:编程就是目前AI创造价值最显著、闭环最快的行业。

对于开发者来说,Vibe Coding(氛围编程)的流行已经证明AI的商业落地必须锚定在具备高频率、高容错闭环的场景。

需要人们每一分钟都盯着运行的AI实习生终究无法融入实际应用场景,因此K2.6选择将自己打造成产品经理。

与此同时,AI行业生产力的定义也在发生变化:人们只会为确定性结果而付费,而不是花钱购买API的调用次数。

这种夸张的执行力飞跃,本质上来源于杨植麟两个月前在英伟达GTC大会上提出的“智能体群”范式。

K2.6的集群架构能够支持300个子Agent并行完成4000个协作步骤,本质上就是在模拟人类社会的工业分工。

一个Agent只是“数字牛马”,但300个Agent集群就是一个完全数字化的大型部门。

更重要的是,这个大型部门并不局限于单一领域,它可以针对全球100个半导体标的执行量化策略,可以匹配100个职位并完全定制简历,甚至能将一篇高质量天体物理论文转化为具体的学术技能、图表和结构化数据集。

这种组织带宽的扩张,恰好印证了为什么开发者是目前全社会对AI付费意愿最强的群体。

对于分散的个体C端用户来说,改变固有的“免费工具”印象并产生付费订阅是全球AI企业都不得不面对的难题。

但对于集群的B端企业开发者来说,这种能并行处理海量输入、大规模执行操作的Agent集群是实打实的生产力工具。

当K2.6以这种庞大的规模开始进行流水线作业时,它就已经完成了从智力展示到生产经济价值的跃迁。

02

用逻辑打破算力垄断

如此恐怖的长程执行和Agent并发能力,不由得让所有人好奇月之暗面究竟是如何实现这一奇迹的。

就在5天前,月之暗面与清华大学联手发布了一篇论文,名为《Prefill-as-a-Service: KVCache of Next-Generation Models Could Go Cross-Datacenter》。

“跑得快还省算力”的秘诀,就藏在这篇论文之中:混合注意力架构与KVCache的深度压缩。

底层架构上的突破也直接回应了AI行业内一个看似矛盾的现象。

过去的两个月中,以OpenClaw为代表的桌面代理伪需求狂潮逐渐落幕。

即便是还在坚持使用的人,也不可避免地面临一个核心困境:

代理工具因为涉及频繁的环境交互和工具调用,导致其Token消耗速度远超常规使用。

如果代理工具无法完成高难度的工程任务,其创造的价值根本无法覆盖高昂的算力成本。

然而,在伪需求清空的同时,真需求却在增加。

国内大厂的Coding Plan价格不降反升,甚至陆续取消Lite级订阅的新购和续订,强推Pro和Max级服务。

这种趋势说明,AI公司正在通过价格杠杆清退那些“调戏AI”的边缘用户,专注于服务那些真正用AI发挥生产力的核心用户。

即便如此,像智谱等企业的订阅服务仍然供不应求,好不容易抢到购买名额的用户也反映一到高峰期就会频繁限速。

价格上涨加上供给短缺,核心原因正是算力成本与真实产出之间的残酷博弈,而AI公司必须让Coding Plan等订阅服务扭亏为盈。

月之暗面也不例外,Kimi采用的Kimi Linear架构,通过数学上的改良把KVCache流量压缩了惊人的13-36倍。这种极致的压缩让跨地域传输KVCache成为可能,同时变得廉价。

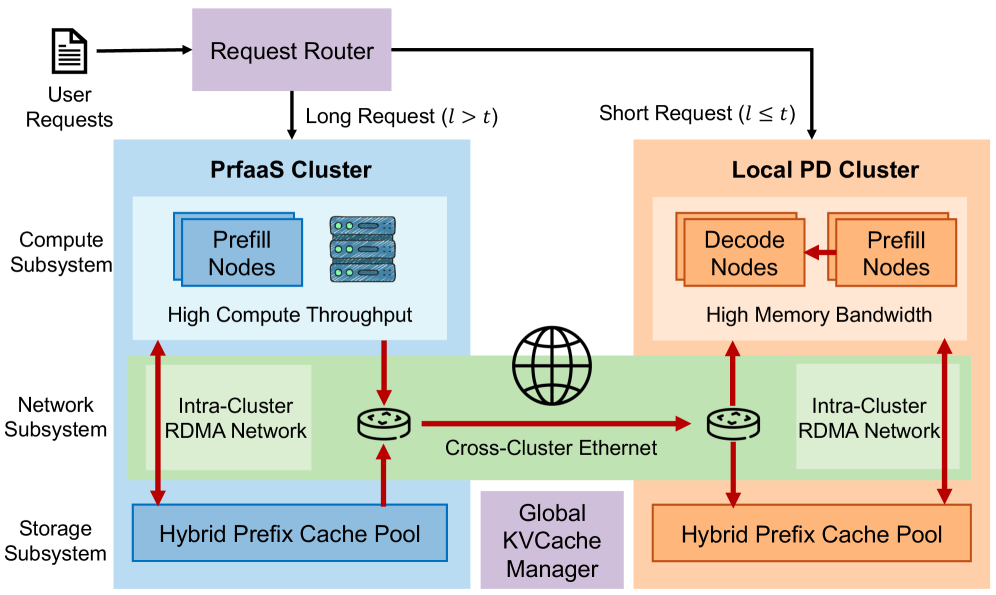

而在系统层面,月之暗面顺势推出了“预填充即服务”(Prefill-as-a-Service, PrfaaS)架构。

它打破了传统推理必须锁死在昂贵的RDMA网络中的物理边界,利用被压缩后的KV流量通过普通的跨中心以太网实现算力调度。

“模型压数据+系统跑调度”的组合使得Kimi能够用昂贵的H200专门负责预填充阶段的理解,而让便宜的显卡在本地运行负责解码生成。

这不仅符合工程美学,还让月之暗面在高价订阅的时代,通过底层基建的降维打击为自己赢得了利润空间。

伴随节约成本而来的,还有智能上限的突破。

杨植麟曾经说过,Token效率不仅仅是工程问题,还关乎智力上限。

通过Muon优化器,Kimi系列模型在相同的训练量下实现了2倍的效率提升,并在1万亿参数规模上解决了训练不稳定的难题。

因此,月之暗面已经向世界证明,通过底层架构的改良可以实现token消耗战中的降本增效。

03

信任链的重塑

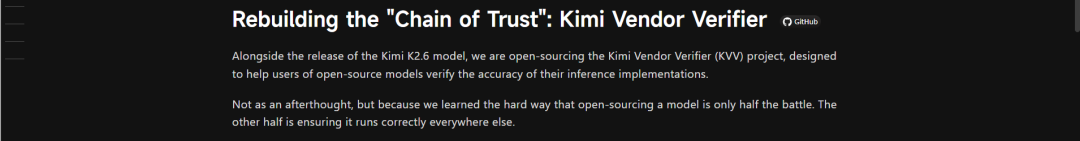

在K2.6的技术博客中,还有一个容易被忽略但十分有趣的事情,那就是月之暗面在开源模型的同时,还开源了KVV(Kimi Vendor Verifier)验证项目。

看似有些多管闲事的举动,实则折射出大模型进入B端交付时代的必然选择。

既然AI行业已经普遍意识到最核心的受众始终是开发者,那么可靠性就一定会成为比智商更重要的准入门槛。

在现有的开源模型生态中,AI企业公布模型权重只是第一步。

然而,这些开源权重被第三方云供应商部署时,往往会出于对节省成本等各种因素的考量,将模型参数进行调整。

如果参数设置不当,就很容易产生各种网购平台上“买家秀”和“卖家秀”的显著差异。

对于较高付费意愿、极低错误容忍度的开发者群体来说,性能上的折损是致命的。

如果用户无法分清到底是“模型不行”还是“部署不行”,开源生态的品牌信任就会轰然倒塌。

KVV的推出,正是月之暗面试图通过“立法”来确立行业规则的一次尝试。

这项评测标准包含OCRBench视觉测试、AIME2025长输出压力测试、SWEBench软件工程测试等六大维度,而月之暗面强制所有接入K2.6的服务商都必须符合官方的参数标准。

换句话说,KVV验证,就是大模型行业的ISO 9001质量控制和Intel Inside的认证体系。

因此,称之为一次极具洞察力的商业阳谋也不为过。

月之暗面已经意识到,国产AI路线目前最多也只能效仿Anthropic走专注于编程的垂直赛道,无法在C端创造出更多的奇迹。

而为了赢得B端开发者的信任,就必须建立起一套透明、可追溯的信任链。

想赚Kimi生态的钱?那就必须在KVV的审查下保持100%诚实。

而通过这种方式,月之暗面就不再只是一个技术的提供方,而是AI生态环境和标准的制定者。

这种权力逻辑的转变,恐怕远比技术突破更值得深思。

04

通往社会操作系统的钥匙

在官方博客的最后,还提到了一个正在内测的服务:Claw群组。

如果说K2.6是引擎,KVV是标准,那么Claw群组就是月之暗面未来蓝图上的组织原型:

一个人类、异构Agent和跨平台工具共生的协同空间。

官方给K2.6的定义很明确,它将作为一个协调者,能接入来自任何设备、任何模型的Agent,并根据其技能画像来动态匹配任务。

事实上,这才是Vibe Coding理想中的形态。

在一个协同的群组中,开发者只需要定义目标和氛围,剩下的复杂步骤由数百个携带不同专业工具的Agent自动分工完成。

回顾K2.6这次深夜发布,逻辑链路已经清晰可见:

通过长程执行解决“能不能干活”;

通过混合注意力架构解决“干活成本贵不贵”;

通过KVV解决“交付标准靠不靠谱”;

通过Claw群组解决“如何和人类一起干活”。

相比于国内互联网大厂,月之暗面在AI领域的起步显然较晚,但其野心却从未止步于做一个最好用的大语言模型。

面对全球范围内的模型性能分水岭和国内激烈的价格竞争,月之暗面选择了一条最务实的道路:

在追赶国际先进模型的同时,专注于B端开发者场景,并通过底层架构的压榨和信任标准的建立,构建一套完整的AI社会操作系统。

而Kimi系列模型的目标,就是成为那个定义规则、管理集群、实现指数级效率跃迁的决策者。

这场起步于追赶的下半场比赛,必将落脚于关于执行和信任的底层效率战争