YuanLab.ai团队今日正式开源发布 源Yuan3.0 Ultra 多模态基础大模型。作为源3.0系列面向万亿参数规模打造的旗舰模型,Yuan3.0 Ultra的发布使全球万亿级开源大模型生态进一步丰富,成为当前业界仅有的三个万亿级开源多模态大模型之一。

Yuan3.0 Ultra将MoE大模型的训练效率优化系统性引入模型结构设计之中,并围绕企业应用及智能体工具调用等方面开展了深度优化,在多模态文档理解、检索增强生成(RAG)、表格数据分析、内容摘要与工具调用等企业级任务中表现突出。这些能力使源Yuan大模型能够高质量处理企业环境中的复杂信息形态,如图文混排文档、多级结构表格以及跨文档知识检索,为基于OpenClaw等智能体框架构建多模态数据驱动的企业Agent AI提供核心能力支撑。

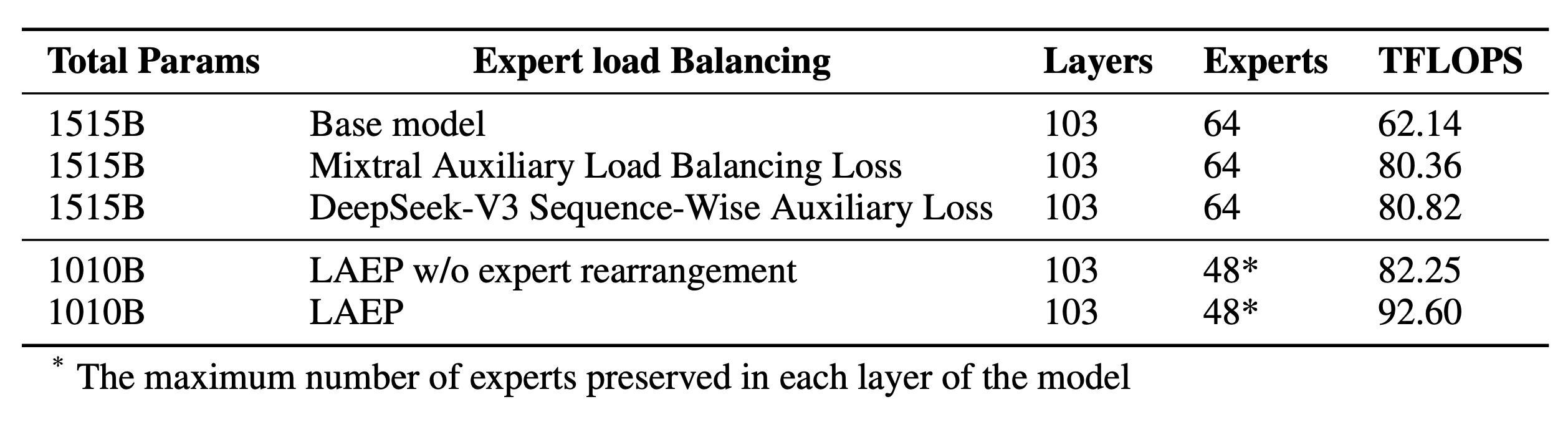

Yuan3.0 Ultra采用统一多模态模型架构,由视觉编码器、语言主干网络与多模态对齐模块组成,实现视觉与语言信息的协同建模。其中,语言主干网络基于混合专家(MoE)架构构建,包含103层Transformer,训练初始阶段参数规模1515B,通过LAEP方法创新,团队在预训练过程中将模型参数优化至1010B,预训练算力效率提升49%。Yuan3.0 Ultra的激活参数为68.8B。此外,模型还引入了Localized Filtering Attention(LFA)机制,有效强化对语义关系的建模能力,相比经典Attention结构可获得更高的模型精度表现。Yuan3.0 Ultra在持续提升模型能力的同时,为大模型发展提供了一条“更高效率、更强智能”的新路径。

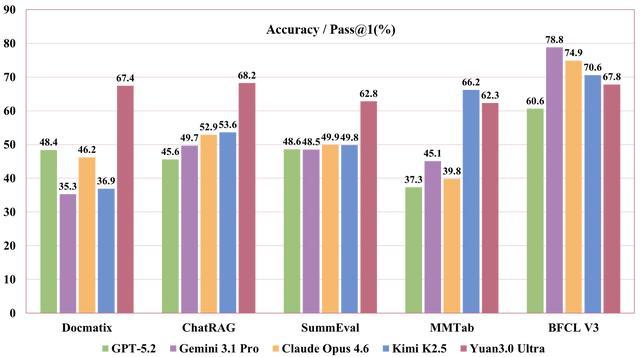

△图1:Yuan3.0 Ultra在面向企业应用的多模态检索、文本检索、摘要生成、表格理解、工具调用评测中表现出色

0 Ultra全面开源,模型参数和代码均可免费下载使用:https://github.com/Yuan-lab-LLM/Yuan3.0-Ultra

面向企业复杂业务场景的多模态能力

企业级Agent通常需要同时处理文档、表格与数据库等多种信息形态,并通过多步骤推理与工具调用完成任务。Yuan3.0 Ultra在设计阶段即围绕企业真实业务流程中的信息处理与任务执行需求进行能力构建。

■ 复杂文档与图表信息理解

在企业实际业务中,大量关键信息存在于技术方案、财报报告、行业研究材料等文档中,这些内容通常包含图文混排结构、复杂表格以及跨页面信息关联,是企业构建知识体系过程的难点。

Yuan3.0 Ultra在DocMatix、MMTab等多模态文档理解评测中领先于Claude Opus 4.6、Gemini 3.1 Pro、GPT-5.2等最新前沿模型,体现出模型在图文结构解析与表格语义理解方面的领先能力。基于这一能力,模型能够准确解析图文混排文档结构并提取关键数据指标,有力支撑智能体系统高质量完成文档理解、数据提取与报告总结等任务,使企业能够从容构建面向文档处理的Agent系统,例如财报分析、合同审阅以及技术文档解析等场景,从而显著提升信息处理质量。

■ 多源信息检索与整合

企业内部知识通常分散在文档库、知识库系统以及业务数据库中,信息来源复杂且结构不统一。要在这样的环境中获取有效信息,不仅需要检索能力,还需要对多源内容进行语义整合与综合分析,而传统检索系统往往只能返回零散结果,难以形成完整结论。

Yuan3.0 Ultra在ChatRAG、SummEval等检索增强生成评测中表现领先于 Claude Opus 4.6、Gemini 3.1 Pro、GPT-5.2等最新前沿模型,体现出模型在检索结果基础上进行深度语义整合与生成回答的能力。依托这一能力,模型可以在企业知识环境中完成检索、理解与综合生成的完整信息处理流程,有力支持 OpenClaw 等智能体利用企业私有知识完成复杂任务。

■ 数据分析与业务决策辅助

在企业运营场景中,大量业务决策依赖数据库查询、报表分析以及跨系统数据整合。在这些场景下,企业往往需要将业务问题转化为数据库查询,并结合数据结果进行分析与总结,而传统流程通常需要人工编写数据库查询语句(SQL)并整理分析报告,效率较低。

Yuan3.0 Ultra在Spider 与 BIRD等Text-to-SQL基准评测中表现出色,在 Spider评测中领先Kimi K2.5, DeepSeek V3.2等前沿大模型,体现出模型在自然语言理解与结构化查询生成方面的能力。依托这一能力,模型能够高质量支持OpenClaw等智能体的数据查询、运营分析以及报告生成等任务,有力支撑企业基于OpenClaw等智能体构建业务分析与决策系统。

LAEP方法创新,不追求更多专家,而是更有效专家

研究团队在长期的大模型算法研究中发现,大模型预训练过程的专家负载演化可分为两个阶段:

第一阶段:初始过渡阶段,发生在模型预训练早期,此时专家负载波动剧烈,受随机初始化影响明显,同一专家所接收的token数量可能在数量级上存在显著差异;

第二阶段:稳定阶段,此时各专家之间的token负载趋于稳定,每个专家接收的token数量仅呈现相对较小的波动;

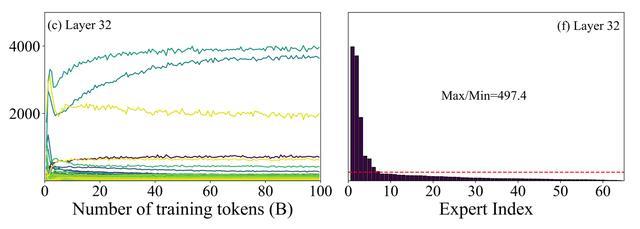

在训练稳定阶段,专家的token负载极不均衡,少数专家承担大量计算,而部分专家长期处于低负载状态,导致算力资源浪费。由图2可以看到,训练稳定阶段最高专家与最低专家负载差异近500倍。

△图2:MoE模型训练过程中存在专家训练不均衡问题

从学习机制角度来看,这一现象实际上是大模型在训练过程中形成Functional Specialization(功能专一化)的体现——不同专家在长期训练中逐渐对特定模式、语义结构或任务类型形成稳定偏好,在模型内部自发涌现出专业化的分工结构。

这与人类大脑的认知组织方式具有一定相似性。神经科学研究表明,大脑皮层并不对所有任务平均分配神经元资源,而是逐渐形成视觉区、语言区、运动区等功能专一化区域,从而显著提升信息处理效率。MoE模型中专家的自发分化,与这一认知机制在本质上一脉相承。

因此,对于大规模MoE模型而言,关键问题在于如何识别并剔除训练后逐渐固化的冗余结构,在保持模型专业化能力的同时,实现算力资源的高效利用。

为解决这一问题,Yuan3.0 Ultra提出针对预训练的Layer-Adaptive Expert Pruning(LAEP)算法。LAEP能够根据预训练过程中形成的专家负载统计信息,动态识别低贡献专家,并对模型结构进行自适应裁剪与专家重排,使计算资源集中于真正发挥作用的专家。从神经科学视角看,这一过程类似于大脑在长期学习过程中对神经连接进行优化与重组:保留高效的信息处理通路,削弱低效连接,从而在维持功能分工的同时提升整体认知效率。

△表1:Yuan3.0 Ultra采用LAEP显著提升预训练效率

实验结果显示:

模型参数减少33.3%

整体预训练效率提升49%

这一研究也揭示了一个重要现象:大模型结构不应只是简单扩大参数规模,而应逐渐演化为具有结构分工与专业化能力的“认知系统”。如何利用训练过程中自然形成的专家分化,并通过结构优化进一步提升学习及计算效率,将成为未来基础大模型结构设计及优化的一个重要方向。

不追求“更长思考”,而是“更有效思考”

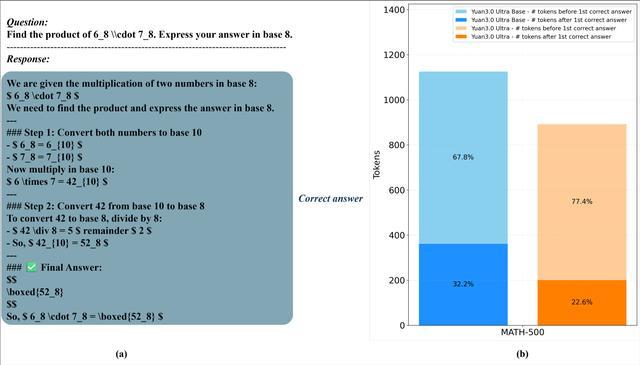

Yuan3.0 Ultra的训练策略聚焦于Fast-thinking 强化学习范式。与单纯延长推理链条不同,模型默认采用高效的短路径推理方式,使计算资源优先用于高信息增益的步骤,而非无约束的反思扩展。

在大规模强化学习过程中,团队围绕反思抑制奖励机制(RIRM)进行了系统优化,通过对反思次数引入奖励约束,使模型在获得可靠答案后主动减少无效反思,同时在复杂问题中保留必要的推理深度。这一机制有效缓解了快思考模式下的“过度思考”(overthinking)现象。

△图3:RIRM优化下的推理效率提升与 Token 消耗对比

训练结果表明,在这一受控快思考策略下,模型精度显著提升,同时推理过程中生成的token数量持续下降,实现了准确性与计算效率的同步优化。

开源基础模型,推动可落地的大模型智能

Yuan3.0 Ultra大模型全面开源,不仅包括模型权重(16bit 与 4bit 模型)、技术报告,也涵盖完整的训练方法与评测结果,支持社区在此基础上进行二次训练与行业定制。Yuan3.0 Ultra提出的LAEP方法是YuanLab.ai团队对下一代基础大模型结构的又一次探索与实践,为业界MoE大模型结构创新、预训练算力效率提升带来新的路径。

YuanLab.ai团队希望通过Yuan3.0 Ultra的开源,推动大模型从“能力展示”走向“规模化落地”,为企业用户提供深度优化的、面向Agent应用的多模态基础大模型。

源Yuan3.0基础大模型将包含Flash、Pro和Ultra等版本,模型参数量为40B、200B和1T等,相关成果将陆续发布。