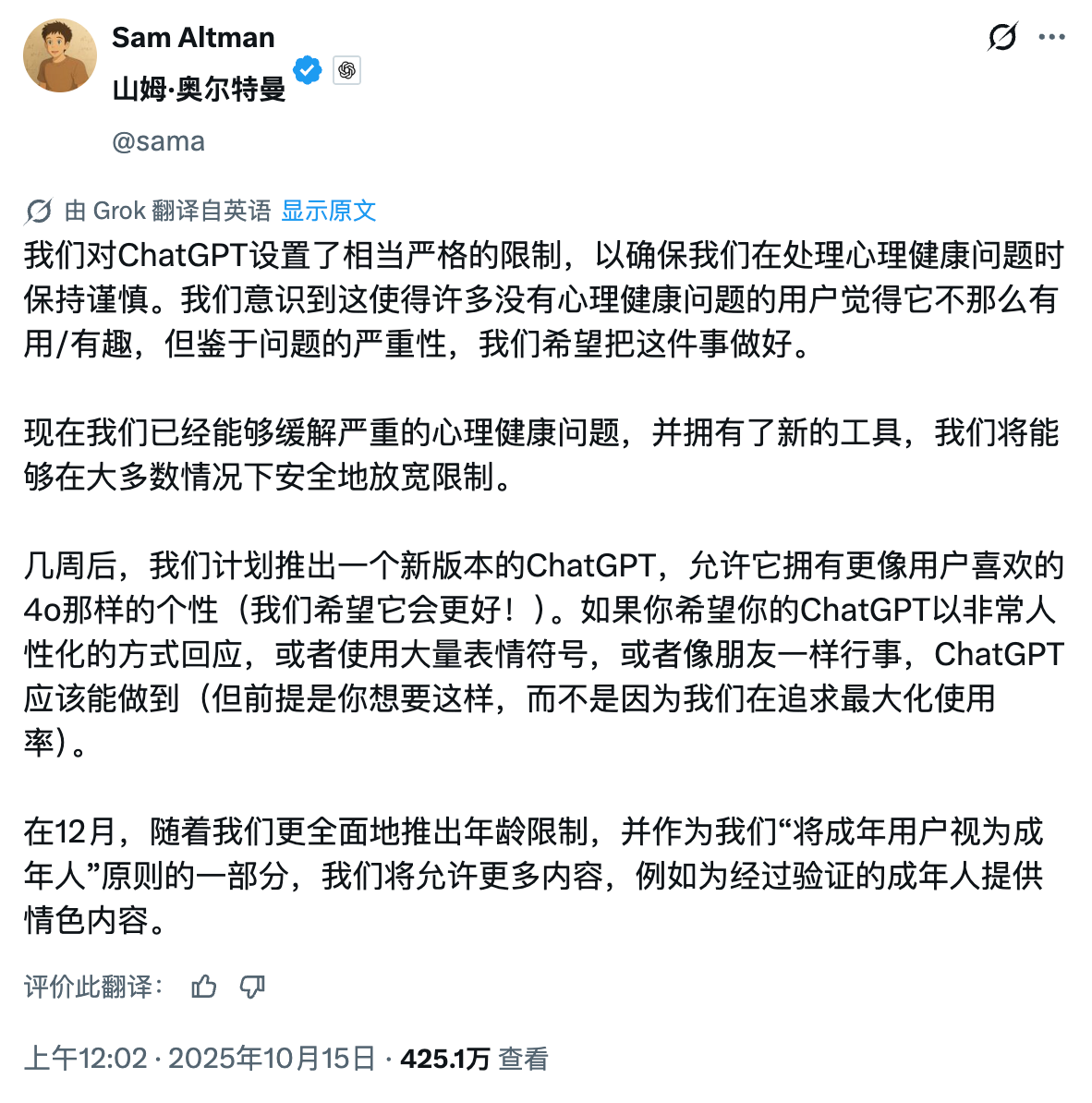

今天凌晨,OpenAI 的 CEO 山姆·奥特曼宣布,ChatGPT 将在 12 月推出「成人模式」。

奥特曼长篇大论地解释了一通,大意是说,ChatGPT 一开始设置那么多限制,主要是担心心理健康问题,怕出事,结果搞得普通用户觉得体验拉胯、不够有趣。

现在 OpenAI 号称已经掌握了新的安全工具,能够减轻心理健康相关的主要风险,所以准备放开手脚了。到了 12 月,经过验证的成年用户可以解锁更多内容,包括情色类内容。

没错,就是你想的那个意思。

一句话概括,OpenAI 声称是时候要把成年人当成年人对待了。不过,作为一名成年人,我却一点都高兴不起来。

另外,按照奥特曼的说法,接下来几周 OpenAI 还会推出一个更有人情味的 ChatGPT 新版本,类似大家之前喜欢的 4o 那种感觉。

你想让它回复更温暖点?没问题。喜欢它狂发 emoji?也行。甚至希望它像朋友一样跟你聊天?统统都可以。

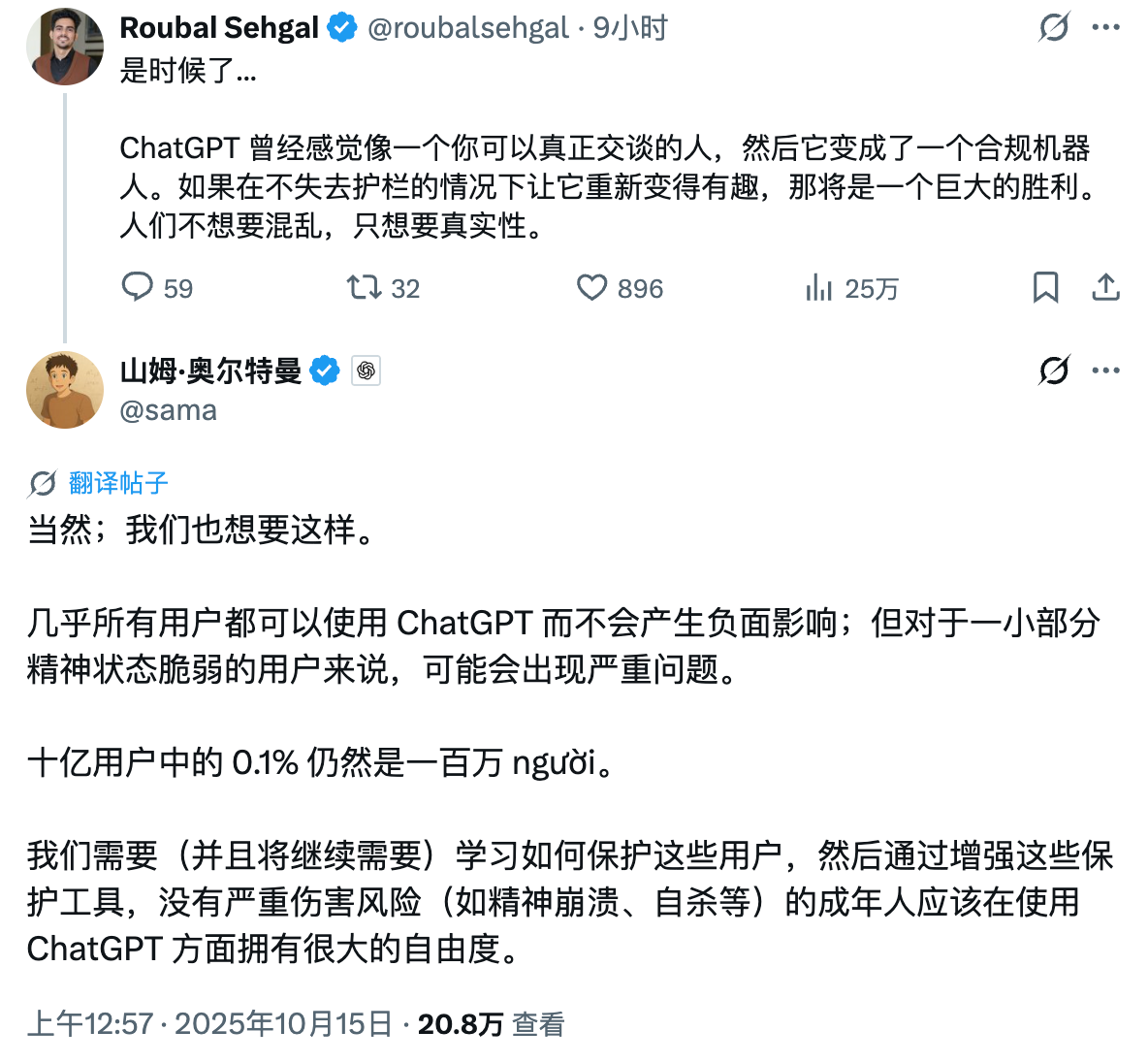

在与网友的问答中,奥特曼还回应了更多细节。

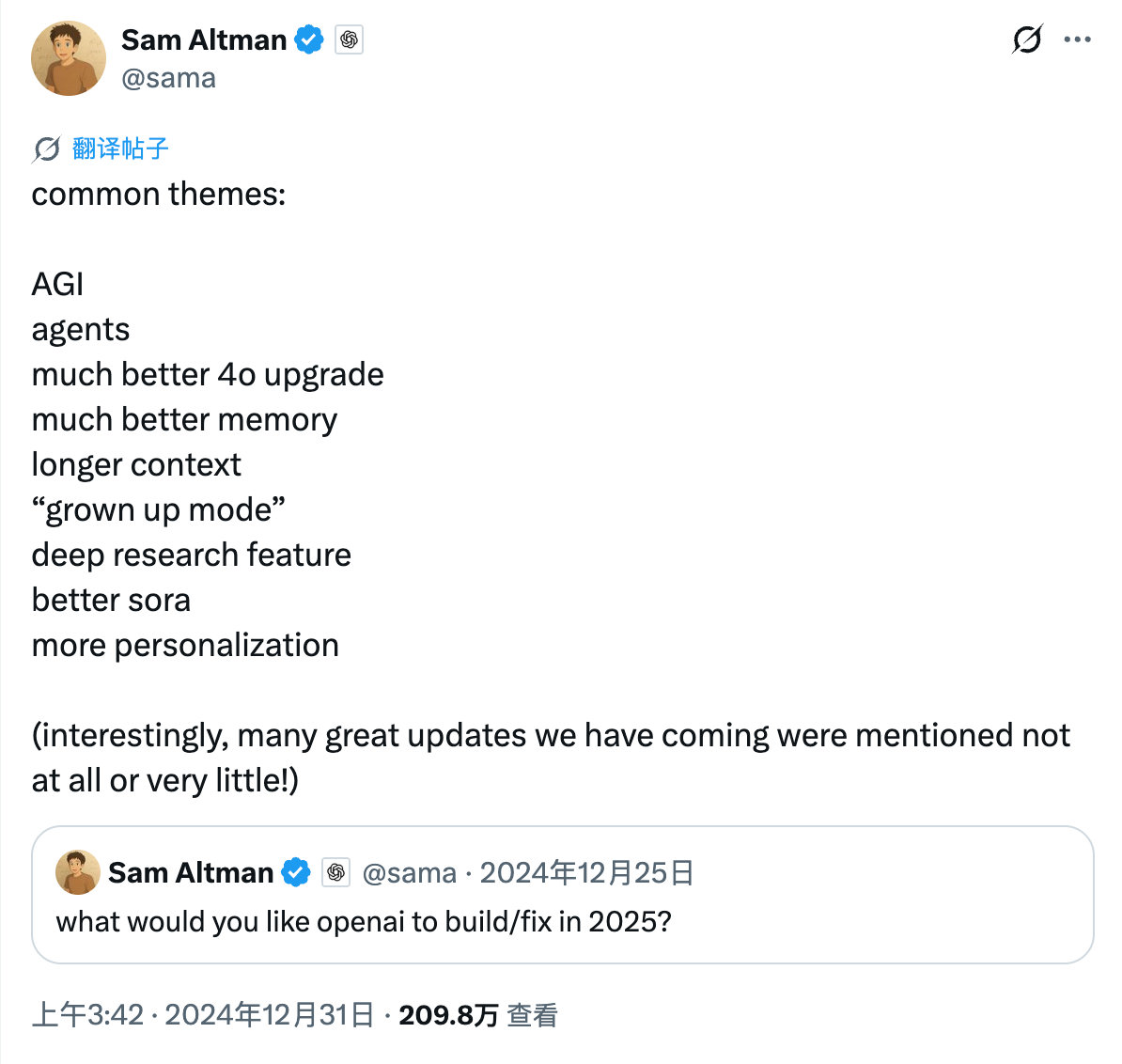

其实 ChatGPT 这事早有征兆。

去年底奥特曼就透露过支持成人模式的计划,当时有网友建议移除模型的大部分护栏,奥特曼当场表态:「肯定需要某种『成人模式』。」

在当时 OpenAI 面向用户征集的新功能投票里,这事一度高居榜首,和 AGI、Agent、升级版 GPT-4 等一起被列入 2025 年产品计划,足见其受重视程度。

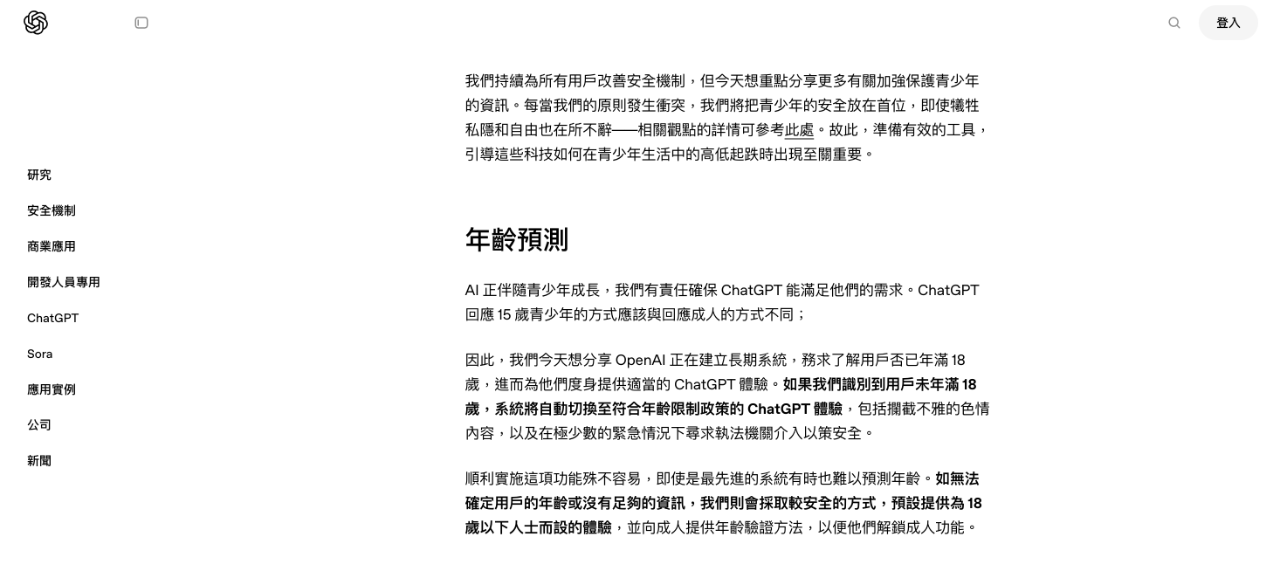

而按照 OpenAI 官方博客,目前年龄验证功能够自动识别未成年用户并切换到青少年安全模式,拦截露骨色情内容;如果无法确定年龄则默认视为未成年,只有提供年龄证明后才能解锁成人功能。

听起来很周全对吧?但细看下来,事情可没那么简单。

听起来很周全对吧?但细看下来,事情可没那么简单。

即便 OpenAI 未来采用身份证件或付款信息核验等方式,规避手段仍然层出不穷。未成年人使用父母身份证件验证、通过成年人代为注册账号,这类操作在互联网产品中早已屡见不鲜。

更关键的是,OpenAI 声称开发了新工具来检测用户心理状态,但 AI 是否真能准确判断一个人的心理健康程度?

要知道,最近几年里,涉及 ChatGPT 的悲剧事件屡有发生,OpenAI 所宣称的「安全阀」是否真能起到应有的保障作用,仍然令人质疑。

有一说一,OpenAI 甚至不是第一个宣布支持「成人模式」的有影响力的 AI 产品,某种程度上还算是保守派。马斯克旗下的 AI 聊天机器人 Grok 才是真·无所顾忌。

今年 7 月份马斯克更是为 Grok 加入了 3D 虚拟伴侣角色功能。

付费订阅「SuperGrok」用户(月费 30 美元)可以启用两款 3D 伴侣:一位是动漫风的金发双马尾少女「Ani」,另一个是卡通红熊猫「Bad Rudy」。

其中 Ani 有着精致的二次元形象,酷似动漫角色弥海砂。Ani 支持文本、语音和摄像头多模态互动,能根据对话内容做出丰富表情和动作,甚至可听令跳舞。

此外,Ani 还内置了好感度机制和记忆模式。用户与其互动能提升虚拟好感度,达到一定等级即可解锁 NSFW(成人)模式。

当时有网友评价:「简直就是高级 Galgame(恋爱游戏)。」这也让 Ani 上线一天就收获大量自发创作内容,迅速在社交媒体出圈。

只是,Grok 也好,ChatGPT 也罢,这些功能表面上打着「尊重成年用户自由」的旗号,但问题在于当年龄验证机制一旦存在漏洞时,开放成人内容实际上是在降低未成年人接触不当内容的门槛。

如果所谓的成年人权利实际上是在拿未成年人的心理健康和成长环境做赌注,赌青少年不会钻空子,那么更严格的限制或许更为稳妥。

而更直白地说,这些功能的商业逻辑依然是争夺用户流量和提升付费转化率。

说白了,AI 产品的粘度普遍不高。

大多数用户都是秉持着哪个好用用哪个的原则,而且专业用户(科研、编程等场景)愿意付费的人数有限,那怎么办?他们选择用更加拿捏人性的方式来让你留下(或者成瘾)。

那就是往「欲望」那边靠。开放成人向功能,一方面能吸引大量新用户尝鲜,满足被过滤掉的需求;另一方面,付费意愿也会大幅提升。

色情和猎奇内容历来是互联网流量催化剂。开放成人向功能,一方面能吸引大量新用户尝鲜,满足被过滤掉的需求;另一方面,付费意愿也会大幅提升。

而更进一步的,其实是情感陪伴这块大蛋糕。

当前 AI 陪伴类产品的核心用户多为年轻网民和特定圈层人群(如二次元爱好者、社恐人群等),但这一版图正持续扩张。年轻人对数字伴侣的接受度最高,不少年轻用户已将 AI 视为日常数字生活的一部分,不仅用于搜索问答,也愿意倾诉情感。

投资机构 ARK Invest 甚至预测,「AI + 情感陪伴」全球市场规模将从每年 3000 万美元飙升至 700 亿~1500 亿美元,年均增长率超过 200%。

但问题是,心理学研究早已证实,人类容易对展现共情的对象产生依恋——哪怕明知对方是程序。这也意味着 AI 存在被情感操控的风险。

目前看,各国监管正在行动。

欧盟的 AI 法案提及高风险 AI 需防止对儿童不利;中国的《生成式人工智能服务管理办法》也强调提供服务应符合未成年保护法等等。

OpenAI 前阵子也主动推出了「青少年模式」:家长可通过邮箱将自己账户与 13 岁以上孩子账户关联,甚至设置宵禁时段。当系统检测到青少年有严重情绪困扰时,还会给家长发送提醒。

也许十年后,拥有一个 AI 伴侣会像今天养宠物一样稀松平常。

但那些被 AI「完美关系」喂养大的一代人,还能不能理解真实人际关系?当你习惯了一个永远不会拒绝你、永远理解你、永远顺着你的 AI,你还有勇气面对一个会跟你吵架、会让你失望、需要你付出的真人吗?

act like a friend,或许是最诱人也最致命的谎言。它学习你的语言习惯、迎合你的价值观、满足你的欲望,然后把这一切包装成懂你的样子反射回来。

这是最好的时代,因为没有人再孤独。这是最坏的时代,因为所有人都在孤独。12 月份的 ChatGPT 或许只是个开始。