作者 | ZeR0

编辑 | 漠影

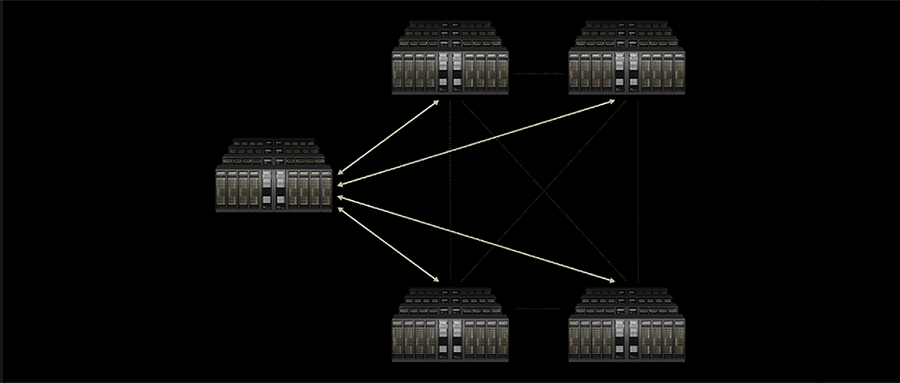

智东西8月23日报道,NVIDIA昨夜推出一项重要网络创新技术——NVIDIA Spectrum-XGS以太网。这项跨区域扩展(scale-across)技术可将多个分布式数据中心组合成一个十亿瓦级AI超级工厂。

NVIDIA Spectrum-X以太网提供横向扩展架构,可连接整个集群,快速将海量数据集传输到AI模型中,并协调整个数据中心的GPU间通信。Spectrum-XGS以太网是NVIDIA Spectrum-X以太网平台的一部分,现可供货。

年度芯片及系统架构顶级会议Hot Chips举行在即,AI推理和网络将成为关注焦点。NVIDIA将在Hot Chips期间重点介绍NVIDIA Spectrum-XGS以太网,并详细分享NVIDIA网络、数据中心机架、神经渲染技术、NVIDIA GB10超级芯片与DGX Spark、集成硅光子学的共封装光学器件(CPO)交换机等推理和加速计算领域的最新技术进展。

随着AI需求的激增,单个设施内的数据中心功率和容量已达到极限。要实现数据中心扩展,必须打破建筑物的限制,而现有的商用以太网网络基础设施因高延迟、高抖动及性能的不可预测而无法满足需求。

对此,NVIDIA Spectrum-X以太网平台新增Spectrum-XGS以太网,通过引入跨区域扩展(scale-across)基础设施打破了上述限制。

NVIDIA创始人兼CEO黄仁勋谈道:“AI工业革命已经到来,而巨型AI工厂是这场变革的核心基础设施。继纵向扩展(scale-up)和横向扩展(scale-out)技术后,我们又通过推出NVIDIA Spectrum-XGS以太网提供跨区域扩展(scale-across)技术,将不同城市、国家乃至大洲的数据中心组合成庞大的十亿瓦级的AI超级工厂。”

跨区域扩展(scale-across)是继纵向扩展(scale-up)和横向扩展(scale-out)之后的AI计算“第三大支柱”。Spectrum-XGS以太网完全集成于Spectrum-X平台,通过算法实现了网络和数据中心设施间距离动态适配。

凭借先进的、自动调节的远距离拥塞控制、精准延迟管理及端到端遥测技术,Spectrum-XGS以太网将NVIDIA集合通信库性能提升了近1倍,加速了多GPU和多节点的通信性能,实现了可预测异地AI集群的性能。这样就可以将多个数据中心组合成一个统一的AI超级工厂运行,全面优化长距离连接性能。

CoreWeave等超大规模云提供商已开始部署这种新基础设施。其中CoreWeave将成为首批使用Spectrum-XGS以太网连接它的数据中心的企业。

Spectrum-X以太网网络平台为多租户、超大规模AI工厂(包括全球最大的AI超级计算机)提供的带宽密度较传统以太网高出1.6倍。该平台由NVIDIA Spectrum-X交换机和NVIDIA ConnectX-8 SuperNIC组成,帮助构建未来AI平台的企业实现无缝扩展、超低延迟和空前性能。

今日最新发布是NVIDIA一系列网络创新技术发布的延续,如NVIDIA Spectrum-X和NVIDIA Quantum-X CPO网络交换机等,这些技术一起能够将位于不同地点的数百万颗GPU组合成AI工厂,突破大规模AI基础设施性能和效率的极限,同时降低能耗和运营成本。