文|徐鑫

编|任晓渔

今年被称为具身智能元年,这一领域当下已成为AI落地最火热的战场。

近日,有着11年的知名视觉AI公司宇泛智能发布了两款具身智能产品,并宣布“智能+硬件”全栈自研,全面拥抱具身智能时代。

看起来跨度不小,但在行业内看宇泛落子具身智能却是顺理成章。

一方面,视觉能力已经成为机器理解物理世界的核心入口,也是多模态智能的基础。视觉出身的团队已经成为具身智能领域的一支中坚力量。进军具身智能,是这家企业能力进化的必然指向。

另外,在“智能+硬件”这条路上,宇泛也有长久的软硬件一体研发经验。视觉AI时代,当时各类设备端的计算性能尚不能支撑AI算法直接落地,而宇泛最早在行业里基于端侧芯片性能重构算法,降低了算法对硬件的消耗,实现了端到端性能优化。

这一整套从底层硬件适配到上层AI算法优化的软硬协同开发经验,让宇泛在视觉 AI 时代吃到了红利,在此基础上快速走通了商业化落地和规模化交付之路。具身智能时代,智能机器人落地同样非常考验软硬协同,宇泛的过往历程无疑为此提供了助力。

“我们想明白了具身智能怎么做,决心利用过去十年积累,在具身智能机器人赛里迅速做到行业头部。这一波AI,不仅要让机器人看得见、听得懂、会交流、能行动,更要让它们真正学会自主思考与决策。”宇泛智能董事长赵弘毅说。

01

为什么全面拥抱具身智能?

具身智能赛道,又添一名新玩家。

几天前,视觉AI领域知名企业宇泛智能召开11周年庆暨合作伙伴大会。会上除了发布新一代视觉AI硬件与Agent新品,宇泛还正式推出了两款具身智能产品——空间认知大模型Manas和四足机器狗,宣告这家有着11年发展历程的人工智能企业正式步入具身智能时代。

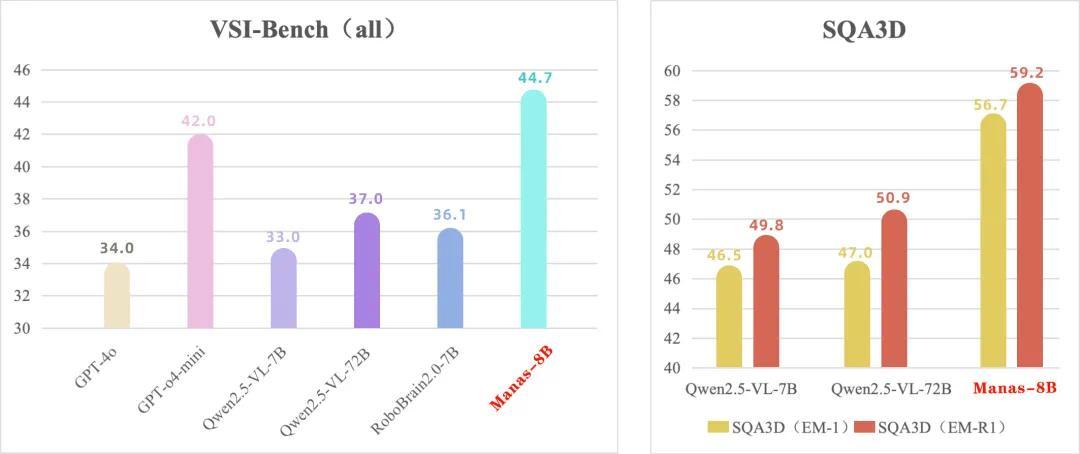

空间认知大模型Manas今年7月已经在宇泛智能的公众号上对外亮相,这是一个多模态语言模型(Multimodal Large Language Model,MLLM)。根据宇泛提供的信息,Manas在业界流行的空间理解数据集VSI-Bench,SQA3D上的表现,相比业界同等规模模型,取得SOTA成绩。

此次正式发布,外界观察到,Manas在宇泛的具身智能战略里的角色进一步明确。未来它将作为宇泛智能旗下具身智能硬件的大脑,扮演空间认知底座角色,让智能硬件能感知真实物理世界,具备自主决策能力。

而新发布的四足机器狗,是宇泛智能推出的第一款具身智能机器人。据介绍,它的机械结构、电机、运动控制平台及能力均由宇泛团队自研。

这两款产品的发布,也让宇泛智能在具身智能时代的战略浮出水面——延续“智能+硬件”基因,全栈自研大脑、小脑和本体,全面拥抱Physical AI。

宇泛选择在当下入局具身智能赛道,对业界而言并不算突兀之举。

实际上随着大语言模型技术的进步,广义的各类硬件的智能程度已经迎来了升级。机器视觉行业头部玩家如海康等都在将多模态的模型植入设备里来提升硬件的智能水平。

在机器人领域,随着机器人与大模型技术深度融合,多模态大模型能力的发展,尤其是视觉能力带来了更强的泛化能力,机器人的“大脑”也在进化。原来的机器人只能完成单体、单一场景任务,现在有望演进为具备更强泛化能力的“通才”。

业界不乏视觉AI领域企业进入具身智能赛道,比如上个月底商汤在WAIC上就发布了具身智能大脑,布局具身智能赛道。

同时,视觉领域的研究者和从业者已经是具身智能领域的一支重要力量。清华大学孙富春教授今年6月在2025北京智源大会的演讲中更是谈到,具身智能历来是两路人在做,一路是计算机视觉派,以视觉为中心,李飞飞是典型代表,另一路是原来机器人领域的从业者。

赵弘毅在演讲中阐述了此次发布背后的战略考量,他强调多模态尤其是视觉能力对具身智能发展至关重要。

赵弘毅指出,宇泛智能当下投身具身智能赛道,既是有着11年技术积累的人工智能公司在产业变革前夜顺应大势的战略抉择,也是公司创始团队做机器人初心“念念不忘”最终在内外部技术条件成熟后迎来的回响。

他透露了一个宇泛创业历程里此前鲜少被外界关注到的细节。2014年,宇泛是用家用机器人的Demo融来了第一笔天使轮投资,“我们最初的创业梦想,就是做智能机器人。”

当时,机器人技术横跨图像识别(感知)、语音交互(理解与对话)、运动控制(行动)三大技术高峰。在技术条件和团队规模等现实条件限制下,最终宇泛选择了最擅长的图像识别赛道来完成商业落地闭环。但这个团队始终未曾放下对智能机器人的梦想和初心。

随着这波大模型浪潮兴起,人工智能也在从AI 1.0向AI 2.0时代演进,具身智能领域已经成为AI落地的主战场之一。机器人在“能看、能听、能说、能动”基础上,在向真正具备自主决策能力进化。其中,视觉正成为机器人具备认知和决策的关键支撑。

“在所有感知方式中,视觉信息密度最高、通用性最强,是机器理解物理世界的核心入口,也是多模态智能的基础。在具身智能场景中,视觉不仅决定机器看到什么,还决定机器下一步做什么。”

这次发布,在赵弘毅看来更像是宇泛的战略进化。视觉在 AI 1.0时代是最清晰的落地方向,而当下视觉有望成为更智能的机器人的入口,加上创始团队始终怀揣机器人梦想,一旦技术储备成熟,他们必然要迈出这一步。

02

拥抱Physical AI,宇泛做了什么

除了视觉基因,宇泛此次一口气拿出两款具身智能产品,也显示了这家人工智能企业在多模态和智能硬件能力上的技术储备。

以多模态能力为例,宇泛过去一年围绕着如何让智能体具备空间理解能力,有不少思考和工作成果。

当下,围绕着如何让机器人具备更智能的大脑,行业内仍处在探索期,技术路线尚未“收敛”,有行业人士认为存在端到端的VLA模型(Vision-Language-Action)、大小脑架构,以及世界模型等多种路线。

技术路线虽有不同,但一个共识是机器人需要具备多模态推理能力,这也被视作AI能够像人类一样综合感知、理解和决策的关键。而多模态的视觉-语言模型又被认为是实现多模态推理的核心基础。因为它能把像素、3D结构、文字都映射到同一高维向量空间,形成“跨模态对齐”。

这里面自然语言是推理过程的显式中间层,既供人类阅读,又供下游策略网络调用。视觉语言模型就扮演了具身智能中连接感知、决策与人类指令的核心控制中枢角色。

但不是所有的多模态模型都适合做大脑。一位行业人士看到,GPT-4o做机器人大脑就不理想,因为缺乏长程规划和空间理解能力。这也是市面上许多多模态语言模型的问题。虽然在图像识别、语言理解等感知任务上表现出色,在它们在空间感知方面仍存在明显短板,比如在细粒度、局部、几何信息的感知,并不如传统纯视觉模型那么精准。

而具身智能场景,机器人需要准确地抓取物体。模型不仅要“看懂”图像的语义内容,更需要具备对三维空间的准确感知能力。比如物体的实际尺寸、相对方位、空间布局等几何信息,都是后续机器人的路径规划、物体操作、环境理解等复杂任务的支撑。

宇泛智能CTO王涛介绍,这意味着机器人“大脑”必须将语言模型与空间感知能力深度融合,才能在真实世界中实现稳健的操作与交互。只有当语义理解与空间推理能力同时具备时,具身智能才有可能真正走向大规模应用。

今年7月亮相的Manas就是一个经过具身智能场景强化的多模态语言模型(Multimodal Large Language Model,MLLM),底座是一个开源大语言模型,他们又专门对其进行了空间理解层面的诱导训练和强化工作,它凝结了宇泛技术团队对具身智能的空间认知以及多模态技术上多项成果。

首先,是去年年底宇泛自研的多模态推理架构UUMM,它参考了大语言模型的架构并使之适配具身智能场景,接收人类的语言和视觉输入,输出行动指令,形成快速迭代优化的闭环。

在此之上,今年3月,宇泛团队又发布了HiMTok,这与宇泛VLA项目一脉相承,通过创新方法实现了大模型图像分割能力的内生式集成,在保持模型结构和参数规模基本不变的前提下,实现了图像理解、图像分割、目标检测等多任务的有机融合。这项工作推动大模型从单一文本输出向图像、机器人动作(Robot Action)等多模态升级上又往前走了一步。

之后他们又基于强化学习技术提升了模型的多模态输出能力。

这一系列的工作使得宇泛的MLLM模型Manas在目标计数、绝对/相对距离、物理尺寸、路径规划以及自我视角的空间关系等空间理解相关的Benchmark上表现优异。Manas发布,意味着宇泛在具身智能大脑的能力储备走向成熟。

而另一款发布产品自研四足机器狗,意味着宇泛也已具备了机器人本体和小脑能力。“各种机器人的零部件链条很成熟的情况下,我们自研了电机和控制平台等核心部件,经过多次迭代,也踩过不少坑,现在已经迭代到了第三代产品”。

宇泛产研团队透露,接下来他们将加速推进机器人的大脑和小脑融合工作。

03

延续“智能+硬件”基因,走全栈自研之路

全栈自研机器人的大脑、小脑和本体,对任何一家新进入的企业都是一个不小的挑战。为什么宇泛会选择走一条全栈自研之路?

数智前线观察,这既与当下具身智能的产业现状相关,宇泛智能过往的企业基因和发展历程又使得这只团队强化了“智能+硬件”的路线认知。

从产业现状看,当下围绕着具身智能的各种技术路线尚未收敛,各类硬件标准尚未统一。有智能算法能力的厂商很难不考虑硬件本体因素,专注于机器人大脑研发。

一位行业人士此前就提到,现在具身智能厂商这么多,不同厂商的本体的自由度、传感器数量都不一样,数据根本不通用。这使得基于数据训练出来的算法就很难跨越本体迁移,也意味着当下厂商们在算法研发时需要充分考虑如何与具身智能硬件之间的配合问题。

宇泛团队告诉数智前线,他们当下走全栈自研路线,就是为了能更好地确保具身智能的产品质量、品控和效果,“大脑、小脑需要融合,这个双系统又都需要和本体之间配合,如果采购外部团队产品,当下阶段很难把这个东西做到极致”。

另一方面,当下产业链条相比前几年已经有了长足的发展。国内雄厚的制造业基础,使得机器人相关的硬件零部件产业链已经十分成熟。除了核心的电机控制零部件自研,其他都可以从产业链获得支撑,这也为宇泛这样的创业公司走全栈自研路线奠定了基础。

同时,宇泛过往的基因,也让他们坚定地在选择了具身智能时代走“智能+硬件”路线。

“‘智能+硬件’是我们的定式,在AI1.0时代,基于‘智能+硬件’路线,我们已经成功地将视觉AI技术深度嵌入安防、工地、社区、酒店等特定场景,实现了技术快速商业化和规模化交付。”赵弘毅说。

这背后就离不开宇泛在软硬件协同上的能力积累。赵弘毅透露,早期的摄像头硬件里无法支撑好的算法应用,因为端侧的算力不够,当时许多做人脸识别的厂商还会专门设备里加一个加速棒来支撑应用落地。

而宇泛则选择了软硬件适配协同和算法创新来解决问题。他们基于硬件性能限制,用类似量化交易领域的“以整型压缩替代浮点、逐层逼近硬件极限”的做法,把模型算法从浮点计算改写为整形计算,并在算子层针对硬件做深度适配与误差补偿,实现了端到端性能优化。

当下具身智能行业快速演进,外界普遍认为这一领域接下来将面临激烈的竞争和洗牌。而宇泛此前的“智能+硬件”协同积累,也为他们参与接下来的行业竞争储备了实力。

赵弘毅进一步认为,在具身智能时代只做算法并不能走远。一方面基础模型需要巨额资源投入,创业公司难与国内外巨头抗衡。更重要的是,根据AI 1.0时代的经验,在国内市场环境下,只基于MLLM来推进机器人大脑,企业很难走通商业落地闭环。

这场角逐同时也十分考验具身智能企业产品验证和量产落地的速度。外界观察到,宇泛过去十一年在智能硬件领域落地的积累,在AI 1.0时代所沉淀的丰富的渠道、供应链、产品化、量产能力和全球销售体系,都有助于这家公司能更好应对市场竞争。

“宇泛有过去十几年积累的经验、资源和人才,团队既年轻又有实战经验,理解大模型的前沿机制,也懂得如何让它们在真实世界高效运行,我们想明白了具身智能怎么做,才来做这件事”,面向新征程赵弘毅很坚定。

宇泛智能成立已有十一年,但这家公司从创始人到核心技术骨干都很年轻,数智前线获悉他们还在继续招兵买马,全力拥抱具身智能新时代。